هوش مصنوعی مولد، نمونههایی مانند ChatGPT نحوه تعامل و دید ما با هوش مصنوعی را متحول کرده است.

فعالیتهایی مانند نوشتن، کدنویسی و درخواست شغل بسیار آسانتر و سریعتر شدهاند.با این حال، با تمام این نکات مثبت اما خطرات بسیار جدی وجود دارد.

یکی از نگرانیهای اصلی در مورد هوش مصنوعی اعتماد و امنیت است که حتی باعث شده است برخی کشورها ChatGPT را به طور کلی ممنوع کنند یا در سیاستهای مربوط به هوش مصنوعی برای محافظت از کاربران در برابر آسیب تجدیدنظر کنند.

آویوا لیتان، تحلیلگر گارتنر، برخی از بزرگترین خطرات هوش مصنوعی مولد را مرور کرده و تأکید میکند که بخش مهمی از این خطرات مربوط به اعتماد و امنیت است و شامل توهمات، جعلهای عمیق، حریم خصوصی دادهها و مشکلات کپیرایت است.

با هم پنج خطر جدی حوزه هوش مصنوعی را مرور میکنیم.

توهم دانایی هوش مصنوعی

توهم دانایی به خطاهایی اشاره دارد که مدلهای هوش مصنوعی با وجود پیشرفته بودن هنوز مستعد انجام آن هستند چون در نهایت انسان نیستند و برای ارائه پاسخ به آموزش و دادهها متکی هستند.

اگر از یک ربات چت هوش مصنوعی استفاده کرده باشید احتمالاً این توهمات را از طریق درک نادرست از درخواست خود یا پاسخ اشتباه آشکار به سؤال خود تجربه کردهاید.

لیتان میگوید دادههای آموزشی میتوانند منجر به پاسخهای مغرضانه یا غیرواقعی شوند در نتیجه اگر افراد برای کسب اطلاعات صرفاً به این رباتها اعتماد کنند، میتوانند به مشکل بخورند.

لیتان میگوید: دادههای آموزشی میتوانند منجر به پاسخهای مغرضانه، غیرمستقیم یا اشتباه شوند، اما تشخیص این مسئله میتواند دشوار باشد، بهویژه از آنجایی که راهحلها به طور فزایندهای قابلباور و واقعی هستند.

دیپفیک؛ وحشت روزافزون

قبل از موج جدید هوش مصنوعی هم صحبت از دیپفیک ترسناک بود.

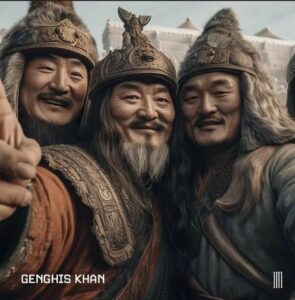

دیپفیک از هوش مصنوعی مولد برای ایجاد فیلمها، عکسها و صداهای ضبط شده استفاده میکند که جعلی هستند اما واقعی به نظر میرسند.

نمونههای کامل این مسئله عکس وایرال شده پاپ فرانسیس با ژاکت پفکرده توسط هوش مصنوعی یا آهنگ Drake و Weeknd تولید شده توسط هوش مصنوعی است که صدها هزار بازدید گرفت و در نهایت خوانندگان رسماً آن را تکذیب کردند.

لیتان میگوید: این تصاویر جعلی، ویدئوها و صداهای ضبطشده برای حمله به افراد مشهور و سیاستمداران، ایجاد و انتشار اطلاعات گمراهکننده و حتی برای ایجاد حسابهای جعلی یا کنترل و نفوذ به حسابهای قانونی موجود استفاده میشوند.

مانند توهم، دیپفیک میتواند به انتشار گسترده محتوای جعلی کمک کند و منجر به انتشار اطلاعات نادرست شود که یک مشکل جدی اجتماعی است و باید فکری به حال آن کرد.

حریم خصوصی اطلاعات و دادهها

حفظ حریم خصوصی نیز یکی از نگرانیهای اصلی هوش مصنوعی مولد است زیرا دادههای کاربر اغلب برای آموزش مدل ذخیره میشود.

این نگرانی عامل اصلی بود که ایتالیا را وادار کرد تا ChatGPT را ممنوع کند و ادعا کرد که OpenAI از نظر قانونی مجاز به جمعآوری دادههای کاربران نیست.

لیتان میگوید: «کارمندان میتوانند به راحتی دادههای حساس و اختصاصی سازمانی را هنگام تعامل با راهحلهای چت ربات هوش مصنوعی در معرض نمایش بگذارند. این برنامهها ممکن است به طور نامحدود اطلاعاتی را که از طریق ورودیهای کاربر جمعآوری شدهاند، ذخیره کنند و حتی از اطلاعات برای آموزش مدلهای دیگر استفاده کنند که محرمانگی را بیشتر به خطر میاندازد.» این اتفاق در مورد یکی از کارمندان سامسونگ افتاد.

لیتان تأکید میکند که اطلاعات ذخیرهشده علاوه بر به خطر انداختن محرمانه بودن کاربر، خطر «به دست مغرضان» افتادن اطلاعات را نیز افزایش میدهد.

امنیت سایبری

قابلیتهای پیشرفته مدلهای هوش مصنوعی مولد، مانند کدنویسی، نیز میتواند به دست افراد نادرستی بیفتد و باعث نگرانیهای امنیت سایبری شود.

لیتان میگوید: علاوه بر مهندسی اجتماعی پیشرفتهتر و تهدیدات فیشینگ، مهاجمان میتوانند از این ابزارها برای تولید کدهای مخرب استفاده کنند.

لیتان میگوید اگرچه ارائهکنندگان هوش مصنوعی مولد معمولاً به مشتریان اطمینان میدهند که مدلهای آنها برای رد درخواستهای مخرب امنیت سایبری آموزش دیدهاند، اما نمیتوانند تضمین واقعی بدهند.

مسائل مربوط به کپیرایت

کپیرایت یک نگرانی بزرگ است زیرا مدلهای هوش مصنوعی مولد بر روی مقادیر انبوه دادههای اینترنتی که برای تولید خروجی استفاده میشوند آموزش میبینند.

این فرایند آموزش بدین معنی است که آثاری که به صراحت توسط منبع اصلی به اشتراک گذاشته نشدهاند، میتوانند برای تولید محتوای جدید استفاده شوند.

کپیرایت موضوعی است که مخصوصاً برای هنر تولید شده توسط هوش مصنوعی به هر شکلی از جمله عکس و موسیقی به یک مسئله جدی بدل شده است.

برای ایجاد یک تصویر از یک متن، ابزارهای تولید کننده هوش مصنوعی، مانند DALL-E، به پایگاه داده بزرگ عکسهایی که در آن آموزش دیدهاند مراجعه میکنند.

نتیجه این فرایند این است که محصول نهایی ممکن است شامل جنبههایی از کار یا سبک یک هنرمند باشد که به او نسبت داده نمیشود.