ابرکامپیوتر جدید انویدیا احتمالاً آینده هوش مصنوعی را تغییر خواهد داد.

DGX GH200 با برخورداری از حافظهای معادل بیش از 500 برابر سیستمهای موجود قرار است بهزودی در دسترس شرکتهایی مثل گوگل، متا و مایکروسافت قرار بگیرد تا پردازش مدلهای هوش مصنوعی را متحول کند.

ابرکامیپوتر DGX GH200 در سطوحی کار میکند که اکثر کاربران با آن آشنا نیستند. برای مثال این محصول توانی معادل 1 اگزافلاپ دارد و از 144 ترابایت حافظه مشترک بهره میبرد. انویدیا میگوید این یعنی حافظه این دستگاه حدود 500 برابر بیشتر از یک DGX A100 است.

برای توضیح بیشتر باید بگوییم که 1 اگزافلاپ برابر با یک کویینتیلیون عملیات ممیز شناور در هر ثانیه (FLOP) است. جهت مقایسه میتوانیم از کارت گرافیک RTX 4090 نام ببریم که در حالت اوورکلاک توانی معادل 100 ترافلاپ دارد.

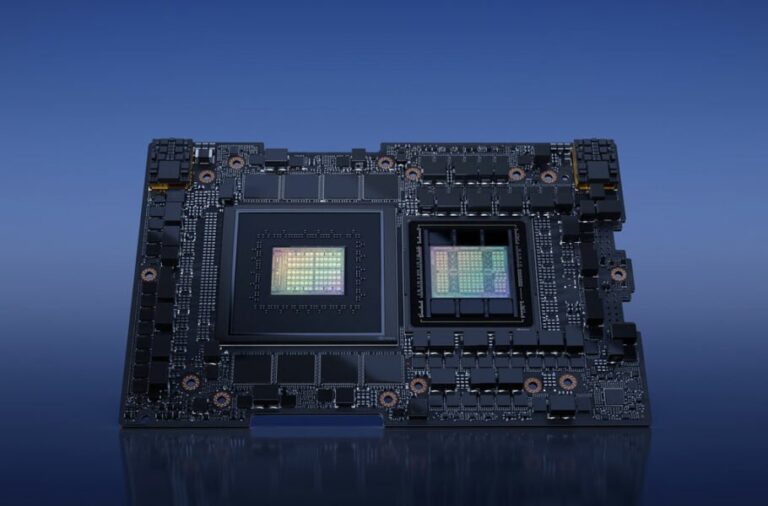

256 ابرتراشه Grace Hopper با هم ابرکامپیوتر انویدیا را میسازند

کامپیوتر DGX GH200 از ابرتراشههای GH200 Grace Hopper بهره میبرد. این کامپیوتر در مجموع به لطف فناوری ارتباط داخلی NVLing حدود 256 نمونه از این تراشهها را در بر گرفته و میتواند از همه آنها بهعنوان یک سیستم یکپارچه استفاده کند و یک GPU عظیم داشته باشد.

ابرتراشههای GH200 در این محصول به ارتباط PCIe معمولی بین CPU و GPU نیازی ندارند. انویدیا میگوید این ابرکامپیوتر از یک پردازنده مرکزی Grace بر پایه آرم و یک پردازشگر گرافیکی H100 Tensor Core بهره میبرد. ارتباط میان تراشهها هم از طریق فناوری NVLink-C2C ممکن شده است.

درنتیجه، پهنای باند میان پردازنده و کارت گرافیک (تا 7 برابر) بهبود یافته و (تا 5 برابر) از نظر مصرف انرژی بهینهتر شده است. باید گفت که فناوری NVLink قبلاً فقط امکان اتصال هشت GPU را فراهم میکرد، اما حالا این رقم به 256 تراشه رسیده است.

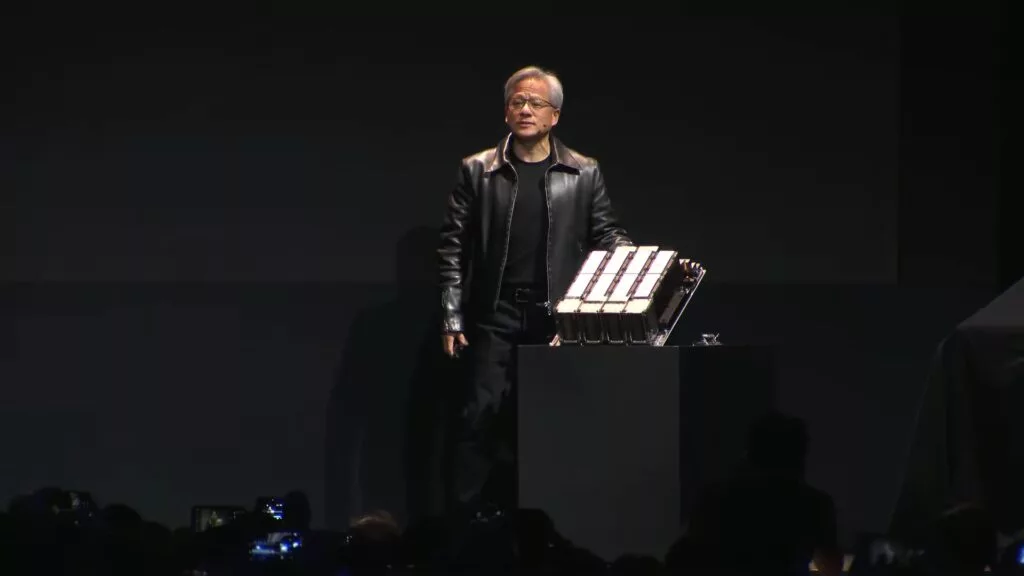

انویدیا با کمک DGX GH200 میخواهد ابرکامپیوتر هلیوس را برای تحقیق و توسعه در زمینه هوش مصنوعی بسازد. این ابرکامپیوتر چهار DGX GH200 خواهد داشت که با Quantum-2 InfiniBand به هم وصل میشوند. این ابرکامپیوتر و GH200 احتمالاً تا پایان سال 2023 عرضه و راهاندازی خواهند شد.

بهعلاوه، DGX GH200 میتواند برای توسعه و پیشرفت مدلهای هوش مصنوعی مایکروسافت، گوگل و متا استفاده شود و به این مدلها اجازه دهد تا پارامترهای بیشتری داشته باشند و کارهای بزرگتری انجام دهند.

منبع: دیجیاتو