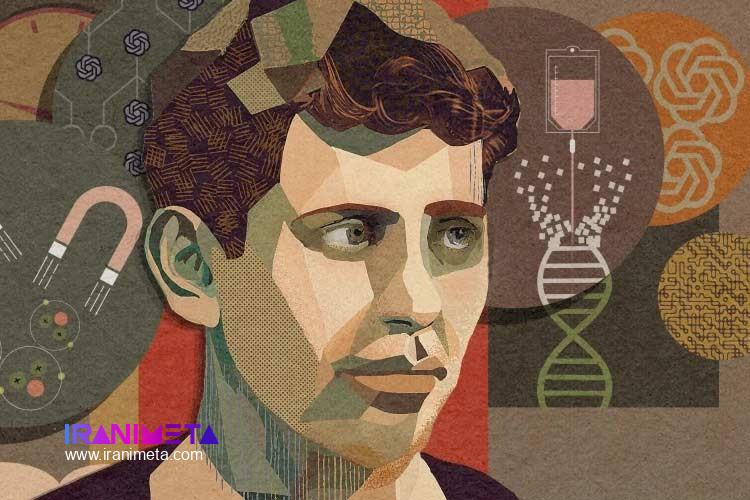

این روزها وقتی سام آلتمن، یکی از بنیانگذاران و مدیرعامل OpenAI صحبت میکند، گوش کردن به آن منطقی است. آخرین سرمایهگذاری پرریسک و پروژه او که این روزها ورد زبان تمام دنیا است GPT-4 و ChatGPT، یکی از پیچیدهترین رابطهای بزرگ مبتنی بر مدل زبانی که تا به امروز ساخته شده است. نکته جالب اما این جا است که وقتی صحبت به مدلهای زبانی میرسد او لزوماً معتقد نیست که بزرگتر بودن همیشه به معنای بهتر بودن است.

آلتمن که در رویداد Imagination in Action در MIT از طریق Zoom حاضر شده بود و برای حاضران سخن میگفت، معتقد است که به محدودیتهای اندازهای LLM نزدیک میشویم. آلتمن گفت: «من فکر میکنم ما در پایان دورانی هستیم که این مدلهای غولپیکر خواهند بود و از راههای دیگر آنها را بهتر خواهیم کرد.»

او تأکید بر مقایسه اندازه مدلهای زبانی را به عنوان یک مقیاس نادرست از کیفیت مدلهای مختلف میبیند و آن را با رقابتهای سرعت تراشهها که دهههای قبل شاهد آن بودیم، مقایسه میکند. من فکر میکنم تمرکز زیادی روی تعداد پارامترها شده است، تعداد پارامترها مطمئناً افزایش می یابد. اما این من را به یاد مسابقه گیگاهرتز در تراشهها در دهههای 1990 و 2000 میاندازد، جایی که همه سعی میکردند به یک عدد بزرگتر برسند.

همانطور که آلتمن اشاره میکند، امروزه ما تراشههای بسیار قدرتمندتری داریم که آیفونهایمان را اجرا میکنند، با این حال ما تا حد زیادی نمیدانیم که چقدر سریع هستند، فقط این که کار را به خوبی انجام میدهند.

آلتمن میگوید: فکر میکنم مهم است که آنچه ما روی آن تمرکز میکنیم افزایش سریع تواناییهای مدلهای زبانی باشد. اگر دلیلی وجود داشته باشد که تعداد پارامترها باید در طول زمان کاهش یابد چنین خواهد شد.

آلتمن میگوید: ما هفت سال است که در حال ساختن این شرکت هستیم و این کارها زمان زیادی میبرد. دلیل موفقیت ما را میتوان در توجه طولانی مدت و دقیق به جزئیات دانست، در حالی که بسیاری چنین کاری نمیکند.

آلتمن مدیر باهوشی است. هنگامی که برخی چهرههای دنیای فناوری مثل ایلان ماسک در یک نامه درخواست توقف شش ماهه OpenAI را داشتند او از رویکرد شرکت خود دفاع کرد، اما در عین حال با برخی از بخشهای نامه موافقت کرد و توجه به آنها را ضروری دانست.

آلتمن میگوید: بخشهایی از اصل حرف نامه وجود دارد که من واقعاً با آن موافقم. ما بیش از شش ماه پس از پایان آموزش GPT-4 صبر و آن را پیش از انتشار بارها تست کردیم. این کار برای درک مشکلات، خط قرمزها و رعایت حدود اخلاقی هوش مصنوعی ضروری است.

وی ادامه میدهد: من همچنین موافقت کردم که با جدیتر شدن قابلیتها، حدود ایمنی و امنیتی باید افزایش یابد. اما متأسفانه من فکر میکنم نامه مورد اشاره از بیشتر نکات ظریف فنی درباره توقف فعالیت غافل شده است. نسخه قبلی نامه ادعا میکرد که ما در حال آموزش GPT-5 بودیم. ما چنین کاری نکردیم و برای مدتی چنین نخواهیم کرد، اما ما کارهای دیگری را در کنار GPT-4 انجام میدهیم که فکر میکنم انواع مسائل امنیتی را دارد که رسیدگی به آنها مهم است.

آلتمن میگوید که درباره مسائل امنیتی و محدودیتهای مدل کنونی صحبت میکند، زیرا معتقد است این کار درستی است. او تصدیق میکند که گاهی اوقات او و سایر نمایندگان شرکت چیزهای احمقانهای میگویند، اما او این ریسک را میپذیرد؛ چون معتقد است باید درباره این مسائل گفتوگو شود.

مثلاً آلتمن اخیراً در مصاحبهای اعلام کرده که این هوش مصنوعی از دید فناوری جذاب، اما از دید محصولی که باید به دست مصرفکننده برسد، افتضاح است، چون قطعیهای زیادی دارد.

آلتمن میگوید: بخش بزرگی از هدف ما در OpenAI این است که دنیا را وادار کنیم تا با ما تعامل داشته باشد و درباره این فناوری فکر کند، و به تدریج مؤسسات جدید بسازد یا مؤسسات موجود خود را با شرایط جدید تطبیق دهد تا بتوانیم بفهمیم که آینده چگونه است.

آلتمن در سال 2015 توسط مجله فوربس بهعنوان برترین سرمایهگذار زیر 30 سال و توسط همکار خود یعنی پل گراهام به عنوان یکی از 5 بنیانگذار استارتآپ جالب بین سالهای 1979 تا 2009 معرفی شد. در مارس 2019 شرکت YC اعلام کرد که آلتمن برای تمرکز بیشتر بر شرکت OpenAI، دیگر رئیس این شرکت نخواهد بود. YC شرکتی است که روی استارتآپهای جدید سرمایهگذاری میکند. حالا آلتمن محصول ریسک خود را دیده و OpenAI تبدیل به یکی از مهمترین بازیگران موج بعدی فناوری شده است.