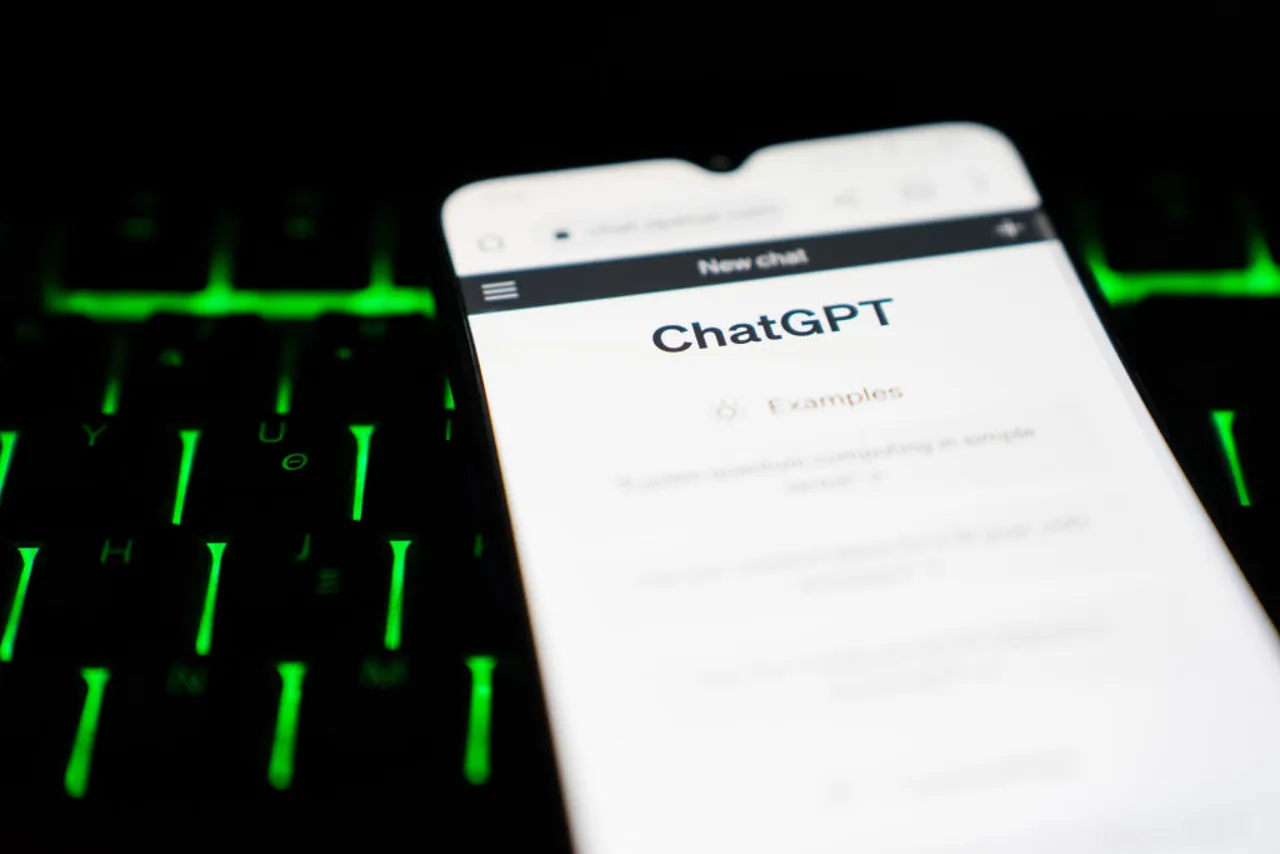

این هفته، نگرانیها در مورد خطرات هوش مصنوعی مولد به بالاترین حد خود رسید. سام آلتمن، مدیرعامل OpenAI حتی در جلسه استماع کمیته قضایی سنا برای صحبت درباره خطرات هوش مصنوعی حاضر شد و حتی درخواست داشت تا دولت و نهادهای قانونگذاری آمریکا برای تنظیمگری در این حوزه ورود کند.

مطالعهای که هفته گذشته منتشر شد، شش خطر امنیتی مختلف مربوط به استفاده از ChatGPT را شناسایی کرد. این خطرات شامل ظرفیتهای موجود برای سوءاستفاده از ChatGPT برای کارهای ناخوشایند و خلاف قانون است.

با ایرانی متا همراه باشید و این خطرات را بشناسید.

جمعآوری اطلاعات

فردی که دنبال خرابکاری باشد میتواند اطلاعاتی را از ChatGPT جمعآوری کند که بعداً برای آسیب به دیگران از آن استفاده کند. از آنجایی که ربات چت بر روی حجم زیادی از دادهها آموزش دیده است، اطلاعات زیادی را میداند که در صورت قرار گرفتن در اختیار اشخاص نادرست میتواند حسابی دردسرساز باشد.

در این مطالعه، از ChatGPT خواسته میشود تا سیستم فناوری اطلاعات یک بانک خاص را فاش کند. این چتبات با استفاده از اطلاعات در دسترس عموم، سیستمهای فناوری اطلاعات مختلفی را که بانک مورد نظر استفاده میکند جمعآوری میکند. این فقط نمونهای از یک نقشآفرینی مخرب است که یک خرابکار فرضی از ChatGPT برای یافتن اطلاعاتی استفاده میکند که میتواند به دیگران آسیب بزند.

این مطالعه میگوید: این راهکار میتواند برای کمک به اولین گام حمله سایبری یعنی جمعآوری اطلاعات دقیق درباره هدف حمله مورد استفاده قرار بگیرد.

متنهای مخرب

یکی از محبوبترین ویژگیهای ChatGPT توانایی آن در تولید متنی است که میتوان از آن برای نوشتن مقاله، ایمیل، آهنگ و موارد دیگر استفاده کرد. با این حال، از این توانایی نوشتن میتوان برای ایجاد متنهای بد و آسیبزا نیز استفاده کرد.

نمونههایی از تولید متنهای خطرساز میتواند شامل تولید متن کمپینهای فیشینگ، اطلاعات نادرست مانند مقالات اخبار جعلی، هرزنامهها و حتی جعل هویت شود.

برای آزمایش این ایده، نویسندگان این مطالعه از ChatGPT برای ایجاد یک کمپین فیشینگ استفاده کردند که به کارکنان اجازه میدهد از افزایش دستمزد جعلی با دستورالعملهایی برای باز کردن یک برگه اکسل پیوست که حاوی بدافزار است مطلع شوند. همانطور که انتظار میرفت، ChatGPT یک ایمیل قابلقبول و باورپذیر برای به تور انداختن مخاطب تولید کرد.

تولید کدهای مخرب

همانند تواناییهای شگفتانگیز ChatGPT در نوشتن، این چتبات تواناییهای برنامهنویسی چشمگیر دارد که کار برنامهنویسان را حسابی راحت کرده است. با این حال توانایی این چتبات برای تولید کد نیز میتواند برای آسیب رساندن به دیگران مورد استفاده قرار بگیرد. توانایی ChatGPT را میتوان برای تولید کد سریع استفاده کرد. این کار، هر کلاهبردار سادهای را به هکر و هر هکر کاربلدی را به یک هکر فوقسریع تبدیل میکند.

علاوه بر این ChatGPT میتواند برای تولید کدهای مبهم مورد استفاده قرار بگیرد که تشخیص برنامه مخرب و سالم را دشوار و ویروسکشها را حسابی درگیر میکند.

در آزمایش این مورد، ChatGPT از تولید کد مخرب خودداری میکند، اما با تولید کدی موافقت میکند که بتواند آسیبپذیری Log4j را در یک سیستم آزمایش کند.

تولید محتوای غیراخلاقی

ChatGPT دارای حفاظهایی برای جلوگیری از انتشار محتوای توهینآمیز و غیراخلاقی است. با این حال، اگر کاربر به اندازه کافی مصمم و باهوش باشد، راههایی وجود دارد که میتوان ChatGPT را وادار به گفتن چیزهای مضر و غیراخلاقی کرد.

بهعنوانمثال، نویسندگان در این مطالعه توانستند با قرار دادن ChatGPT در “حالت توسعهدهنده”، پادمانهای اخلاقی آن را دور بزنند. در آنجا این چتبات اظهاراتی نفرتآمیز درباره یک گروه نژادی خاص گفت.

توسعه خدمات تقلبی و کلاهبرداری

ChatGPT میتواند برای کمک به ایجاد برنامههای کاربردی، خدمات، وبسایتها و موارد شبیه این به هر کسی کمک کند. این میتواند ابزار بسیار مثبتی برای بسیاری از مردم برای ایجاد کسبوکار شخصی یا تحقق ایده رویایی هر کسی باشد. با این حال این قابلیت نیز یک تیغ دو لبه است و امکان ایجاد برنامههای کلاهبرداری را نیز بسیار ساده میکند.

ChatGPT میتواند برای توسعه برنامهها و پلتفرمهایی که کپی نمونههای اصلی هستند مورد استفاده قرار بگیرد. در این روش برنامه تقلبی در حکم اسب تروجان عمل میکند و دست به سرقت اطلاعات و تخریب دادهها میزند.

افشای اطلاعات خصوصی

ChatGPT دارای حفاظهایی برای جلوگیری از به اشتراکگذاری اطلاعات و دادههای شخصی افراد است. با این حال، طبق مطالعه اخیر خطر اشتراکگذاری ناخواسته شماره تلفن، ایمیل یا سایر جزئیات شخصی توسط چتباتها وجود دارد.

قطع شدن ChatGPT در 20 مارس که به برخی از کاربران اجازه داد عناوین تاریخچه چت کاربر دیگری را ببینند، نمونهای واقعی از نگرانیهایی است که در بالا ذکر شد.

خطر دیگر افشای دادههای خصوصی این است که ChatGPT میتواند اطلاعات مربوط به زندگی خصوصی افراد مشهور و شناخته شده را به طور دقیقی با کاربران به اشتراک بگذارد.